2025년 하반기 데이터: 데이터의 세계는 2025년 말에 이르러 거대한 전환점을 맞이하고 있습니다.

불과 1, 2년 전만 해도 우리는 ‘검색 증강 생성(RAG)’이라는 단어에 열광하며 단순히 PDF를 업로드하고 질문에 답하는 챗봇을 만드는 데 집중했습니다.

하지만 2025년 하반기에는 아래와 같은 질문들이 쏟아지고 있습니다.

“우리 RAG 시스템은 왜 자꾸 헛소리를 하나요?”

“벡터 데이터베이스 비용이 왜 이렇게 많이 나오죠?”

“에이전트가 스스로 판단하게 하려면 데이터를 어떻게 설계해야 하나요?”

이제 데이터 엔지니어링과 아키텍처는 단순히 ‘데이터를 옮기는 일’에서 ‘인공지능의 사고 체계를 설계하는 일’로 진화하고 있습니다.

Domain: 지능형 검색과 컨텍스트 엔지니어링의 진화

RAG 2.0: 단순한 검색을 넘어선 ‘컨텍스트 엔지니어링’의 탄생 [1, 2]

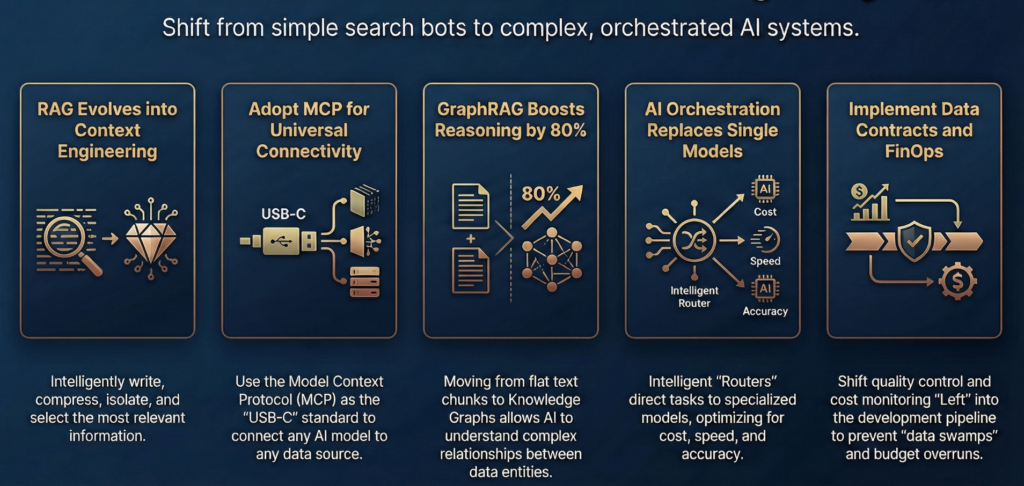

우리가 흔히 알던 RAG는 이제 ‘컨텍스트 엔지니어링(Context Engineering)’이라는 더 크고 정교한 개념으로 흡수되고 있습니다.

2025년 중반부터 가장 화두가 된 이 용어는 단순히 데이터를 ‘검색’하는 것이 아니라, 에이전트가 과업을 수행하는 과정에서 컨텍스트 창(Context Window)을 어떤 정보로, 어떻게 채울 것인가를 체계적으로 관리하는 학문적, 기술적 영역을 의미합니다. [1, 2]

과거의 RAG가 일회성 질문에 대한 문서를 찾는 수준이었다면,

현재는 컨텍스트 엔지니어링은 에이전트가 작업을 수행하는 긴 여정 속에서 정보를 쓰고(Write),

너무 길어진 정보를 압축하며(Compress),

서로 상충하는 정보가 추론을 방해하지 않도록 격리하고(Isolate),

현재 단계에 꼭 필요한 정보만 선택(Select)하는 지능적인 루프를 포함합니다. [2]

예를 들어, 에이전트가 복잡한 시장 분석 보고서를 작성할 때 이전 단계에서 요약한 통계 데이터를 기억하면서도,

현재 작성 중인 섹션과 관련 없는 데이터는 잠시 가려두어 모델의 추론 오류를 방지하는 것이 바로 컨텍스트 엔지니어링의 핵심입니다. [2]

| 단계 | 주요 작업 (Core Operations) | 설명 |

|---|---|---|

| Write | 정보의 영속성 확보 | 에이전트가 과업 수행 중 얻은 지식을 메모리나 외부 저장소에 기록 [2] |

| Compress | 컨텍스트 최적화 | 컨텍스트 창이 꽉 찼을 때 중요도가 낮은 정보를 요약하거나 제거 [2] |

| Isolate | 맥락 오염 방지 | 상충하는 정보(Context Rot/Poisoning)가 추론을 방해하지 않도록 분리 [2] |

| Select | 동적 정보 추출 | 현재 에이전트의 경로에서 가장 필요한 정보만 정밀하게 선택 [2] |

이러한 변화가 중요한 이유는 인공지능 모델에 입력되는 컨텍스트 데이터의 비용 때문입니다.

2025년 말 기준, AI 모델의 입력 비용은 출력 비용보다 약 300~400배 더 큽니다. [1]

만약 불필요한 메타데이터나 비어 있는 벡터 배열, 정제되지 않은 HTML 코드 등을 그대로 컨텍스트 창에 집어넣는다면,

팀은 막대한 비용 효율성 저하와 모델 성능 하락이라는 이중고를 겪게 될 것입니다. [1]

MCP(Model Context Protocol): AI를 위한 표준의 등장

[1, 2, 3]

데이터 소스는 너무나 많고, 이를 AI 모델에 연결하는 방법은 제각각이었습니다.

하지만 2024년 말 앤트로픽(Anthropic)이 발표하고 2025년 말 현재 업계 표준으로 자리 잡은 ‘모델 컨텍널 프로토콜(MCP)’은 이 문제를 획기적으로 해결하고 있습니다. [1, 2]

MCP는 AI 애플리케이션이 어떤 데이터 소스에도 커스텀 통합 없이 연결될 수 있도록 하는 유니버설 표준입니다. [1]

과거에는 Slack, Google Drive, Postgres DB를 각각 연결하기 위해 복잡한 커넥터를 만들어야 했지만, 이제 MCP 서버 하나만 구축하면 모든 AI 모델(Claude, GPT 등)이 이 프로토콜을 통해 안전하게 데이터를 주고받을 수 있습니다. [2]

이는 데이터 사일로를 제거하고 에이전트가 더 빠르고 정확하게 기업 내부 지식에 접근할 수 있게 만드는 기초 인프라가 되었습니다. [2]

마치 모든 전자기기가 USB-C 포트로 통일되면서 생활이 편리해진 것과 같은 혁명이 데이터 아키텍처 세계에서 일어나고 있는 것입니다. [1]

GraphRAG: 관계를 읽는 AI와 지식 그래프의 결합

단순한 텍스트 조각을 찾는 방식의 한계를 극복하기 위해 ‘GraphRAG’가 대세로 떠올랐습니다.

기존 RAG가 평면적인 텍스트 청크를 검색했다면, GraphRAG는 데이터 간의 관계를 지식 그래프(Knowledge Graph) 형태로 저장하고 이를 모델이 추론에 활용하게 합니다. [2]

Microsoft의 GraphRAG 연구에 따르면, 이 방식은 데이터셋 전체의 주제를 파악하거나 복잡한 엔티티 간의 관계를 설명하는 데 있어 기존 방식보다 70~80% 더 높은 성능을 보입니다. [2]

예를 들어 “A라는 인물이 B라는 회사에 미친 영향은?”이라는 질문에 대해, 기존 RAG는 A와 B가 동시에 언급된 문서만 찾지만, GraphRAG는 A가 주도한 프로젝트, 그 프로젝트가 참여한 팀, 그 팀의 성과가 회사 매출에 기여한 경로를 그래프 상에서 추적하여 답변합니다. [2]

이제 지식 그래프는 단순한 메타데이터 관리 도구를 넘어 AI의 추론을 돕는 ‘시맨틱 백본(Semantic Backbone)’이 되었습니다. [2]

현대적 데이터 아키텍처

과하게 설계된(Over-engineered) 검색 시스템이 주는 교훈[4]

성공적인 검색 시스템을 구축하기 위해서는 단순히 벡터 데이터베이스 하나를 쓰는 것으로는 부족합니다.

2025년 말의 모범 사례는 Qdrant와 Redis를 결합한 다층 저장 아키텍처를 보여줍니다. [4]

Qdrant는 시맨틱 검색과 키워드 검색을 결합한 하이브리드 검색을 담당하고, Redis는 실시간 메타데이터와 전체 청크 데이터를 저장하여 검색된 결과의 앞뒤 문맥(Neighbor chunks)을 즉각적으로 확장하는 역할을 합니다. [4]

| 아키텍처 구성 요소 | 사용 도구 | 주요 전략 |

|---|---|---|

| 벡터 저장소 | Qdrant | BM25 + 시맨틱 하이브리드 검색, 고차원 인덱싱 [4] |

| 메타데이터 저장소 | Redis | 인접 청크(Neighbor) 링크 저장, 권한 및 타임스탬프 관리 [4] |

| 청킹 전략 | Docling, LlamaParse | 표(Table) 구조 보존, 의미 단위 스마트 병합 [4] |

특히 표 형식의 데이터(Excel)를 처리할 때 단순히 텍스트로 바꾸는 것이 아니라, 각 행을 “주문번호: 1001, 고객: Alice”와 같이 시맨틱 매칭이 가능하도록 변환하고, 관련 문서로 즉시 이동할 수 있는 ‘키(Keys)’ 필드를 포함하는 전략이 중요해졌습니다. [4]

PDF 역시 단순 파싱을 넘어 표와 본문의 위치 정보를 정밀하게 매핑하여 검색 시 정확한 맥락을 유지해야 합니다. [4]

AI 오케스트레이션: 모델이 아닌 ‘시스템’의 설계

2026년을 바라보는 지금, 가장 큰 기술적 돌파구는 하나의 거대 모델을 만드는 것이 아니라 여러 모델과 도구들을 조율하는 ‘AI 오케스트레이션(Orchestration)’에 있습니다. [3]

이는 마치 모놀리식 애플리케이션이 마이크로서비스로 쪼개졌던 것과 비슷합니다.

AI 애플리케이션은 이제 세 가지 레이어로 구성됩니다. [3]

1. 모델 레이어: 기본이 되는 LLM들.

2. 도구 레이어: 검색, 계산, API 호출 등을 수행하는 컴포넌트들.

3. 오케스트레이션 레이어: 어떤 모델에게 어떤 일을 맡길지 결정하고, 흐름을 관리하는 ‘두뇌’ 역할. [3]

여기서 핵심은 ‘라우터(Router)’의 역할입니다.

사용자의 질문이 코드에 대한 것이면 전용 코드 모델로 보내고, 일반적인 질문이면 가벼운 모델로 보내 비용과 속도를 최적화하는 기술이 실무의 핵심으로 부상했습니다. [3]

산업별 변화와 플랫폼의 진화

제조 현장의 디지털 전환: 스마트 팩토리와 데이터 엔지니어링 [5]

제조업은 이제 데이터 엔지니어링의 가장 역동적인 무대 중 하나입니다. 수많은 IIoT 센서, 로봇, ERP 시스템에서 쏟아지는 테라바이트급의 데이터를 실시간으로 처리하여 가동 중지 시간을 줄이고 효율성을 높이는 것이 핵심입니다. [5]

2025년 말의 데이터 엔지니어링 서비스는 레거시 시스템과 최신 클라우드 플랫폼을 API와 ETL 도구로 연결하여 대규모 인프라 교체 없이도 데이터 중심의 운영을 가능하게 합니다. [5]

제조 현장에서의 데이터 엔지니어링 5단계: [5]

• 1단계(수집): 데이터베이스, 웹사이트, 센서 등에서 클라우드 저장소로 데이터 이동.

• 2단계(저장): 데이터 레이크(비정형)와 데이터 웨어하우스(정형)를 결합한 통합 저장소 구축.

• 3단계(통합): 사일로화된 부서별 데이터를 연결하여 전체 가시성 확보.

• 4단계(처리): 분석 가능한 형태로 원시 데이터 가공 및 표준화.

• 5단계(시각화): AI 기능이 탑재된 대시보드를 통해 현장 의사결정 지원. [5]

비용 인식과 FinOps의 귀환

FinOps(핀옵스, Financial Operations)는

클라우드 비용을 투명하게 관리하고 비용 효율성을 최적화하여 비즈니스 가치를 극대화하는 문화적 관행입니다.

클라우드 지출의 가시성을 확보하고 데이터 기반의 의사결정을 통해 낭비를 줄이는 것이 핵심입니다

클라우드 비용에 대한 무감각했던 시대는 끝났습니다. 데이터 엔지니어링 업무는 조직에서 가장 비용이 많이 드는 분야 중 하나가 되었으며, 2026년의 엔지니어는 자신이 짠 쿼리 하나가 얼마의 비용을 발생시키는지 실시간으로 모니터링해야 합니다. [6]

무분별한 스토리지 사용 대신 전략적인 계층화를 활용하고, 컴퓨팅 자원을 예약된 시간에만 가동하며, 불필요한 데이터 변환을 줄이는 ‘지속 가능한 데이터 플랫폼’ 구축이 엔지니어의 핵심 성과 지표가 되었습니다. [6]

References

1. 10 Data + AI Observations for Fall 2025 | Towards Data Science, https://towardsdatascience.com/10-data-ai-observations-to-watch-in-fall-2025/

2. Is RAG Dead? The Rise of Context Engineering and Semantic …, https://towardsdatascience.com/beyond-rag/

3. Beyond Giant Models: Why AI Orchestration Is the New Architecture – KDnuggets, https://www.kdnuggets.com/beyond-giant-models-why-ai-orchestration-is-the-new-architecture

4. How to Build an Over-Engineered Retrieval System | Towards Data …, https://towardsdatascience.com/how-to-build-an-overengineered-retrieval-system/

5. How Data Engineering Can Power Manufacturing Industry Transformation – KDnuggets, https://www.kdnuggets.com/2025/11/damcosolutions/how-data-engineering-can-power-manufacturing-industry-transformation

6. 5 Emerging Trends in Data Engineering for 2026 – KDnuggets, https://www.kdnuggets.com/5-emerging-trends-in-data-engineering-for-2026