Spark 이해하기 4. Spark Action

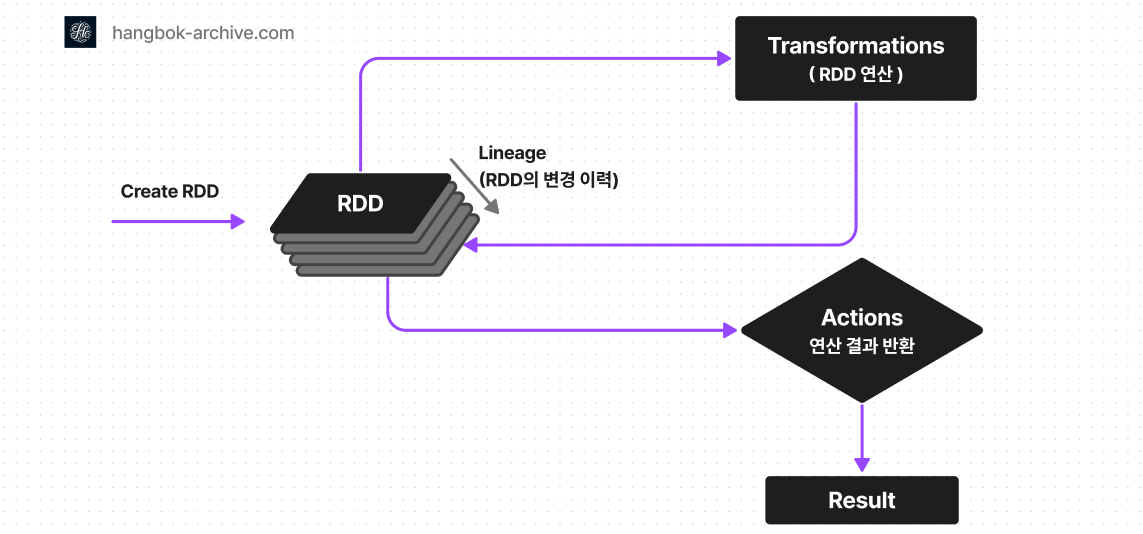

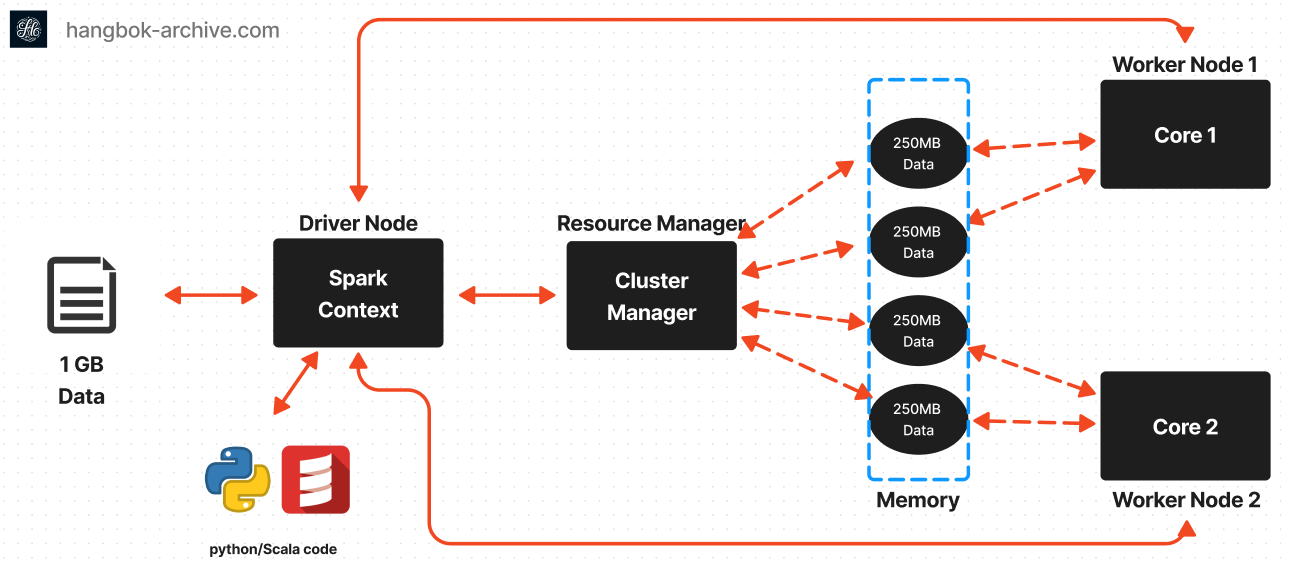

Apache Spark Action 은 RDD(Resilient Distributed Dataset)의 변환에 의해 정의된 전체 계산 계획의 실행을 트리거하는 작업입니다. action은 Spark에 계산을 수행하고 결과를 생성하도록 지시하여 Spark가 클러스터 노드에서 실행될 작업을 시작하도록 합니다. action의 예로는 RDD의 모든 데이터를 드라이버 프로그램으로 검색하는 ‘collect()’, RDD의 요소 수를 계산하는 ‘count()’ 등이 있습니다. Spark Action 함수 정리 Action Function Purpose Example Input … Read more