해당 포스트는 ‘AI 모델 성능 지표’ 에 대해 정리한 내용을 포함합니다.

AI 모델 성능을 비교 분석해주는 서비스에 대한 글은 아래 포스트를 참고하세요

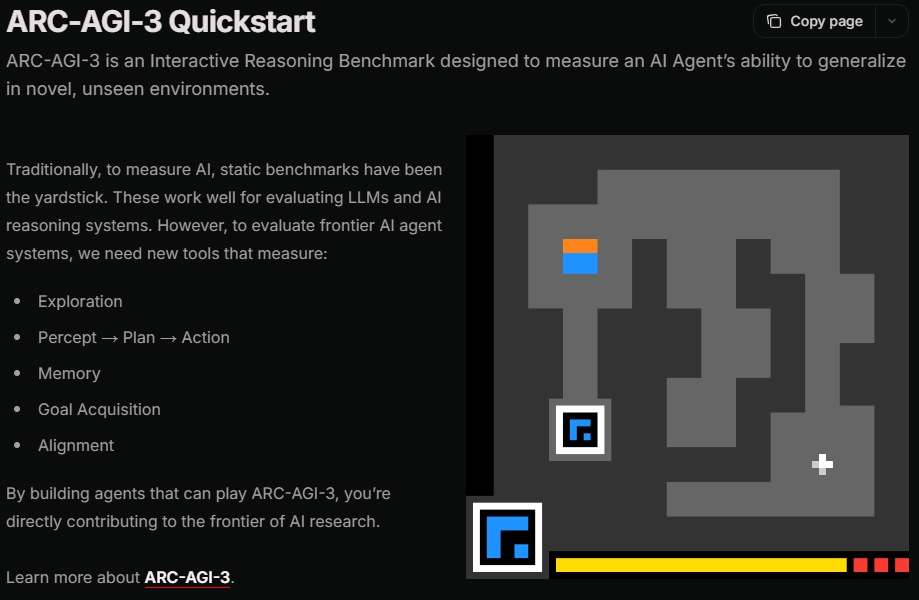

ARC-AGI-3 벤치마크: 에이전트 인텔리전스의 새로운 최전선

ARC-AGI(Abstraction and Reasoning Corpus for AGI)는 François Chollet이 2019년에 창안하고 ARC Prize 재단이 운영하는 벤치마크 시리즈로, 현재까지 가장 공식적으로 AI의 유동 지능(Fluid Intelligence)을 측정하는 척도로 평가받습니다.

2026년 3월 25일 출시된 ARC-AGI-3은 시리즈 최초의 대형 포맷 변환으로, 정적(Static) 격자 퍼즐에서 동적(Interactive) 환경으로 근본적인 전환을 이뤘습니다.

ARC-AGI 시리즈의 계보

- ARC-AGI-1 (2019): 2~5개의 입력-출력 격자 예시가 주어지면 그 변환 규칙을 추론하여 새로운 입력에 적용하는 정적 형식. OpenAI o3가 2024년 87.5%를 기록하며 사실상 포화 상태에 진입.

- ARC-AGI-2 (2025): 동일한 정적 형식을 유지하되 과제의 조합적 복잡성을 높임. 현재 최고 상업 모델(Claude Opus 4.5 Thinking, 64k)이 37.6%, 정제(Refinement) 솔루션 최고 점수 54%(Gemini 3 Pro 기반).

- ARC-AGI-3 (2026년 3월): 150개 이상의 환경, 1,000개 이상의 레벨로 구성된 완전 인터랙티브 벤치마크. 인간은 100% 달성, 프런티어 AI는 출시 시점 기준 0.51%.

채점 방식: RHAE(Relative Human Action Efficiency)

ARC-AGI-3의 핵심은 지시문도, 규칙도, 목표도 일절 주어지지 않는다는 점이다.

AI 에이전트는 게임과 같은 환경 속에서 스스로 탐색하며 규칙을 파악하고, 목표를 추론하여 점점 어려워지는 레벨을 완수해야 한다.

탐색(Exploration), 계획(Planning), 기억(Memory), 목표 획득(Goal Acquisition)이 모두 요구된다.

점수는 RHAE 지표를 기반으로 다음 3단계로 산출된다.

- 레벨별 점수(Per-Level Score): 해당 레벨을 완수하는 데 사용한 AI 행동 수 대비 인간 기준 행동 수의 비율. AI가 인간보다 빠르게 완수해도 점수 상한은 1.0(100%)으로 고정되며, 미완수 시 0점.

- 게임 점수(Game Score): 레벨 번호를 가중치로 하는 가중 평균. 레벨 1은 가중치 1, 레벨 2는 가중치 2… 등으로 후반 레벨일수록 더 큰 비중을 가져 튜토리얼 레벨의 영향을 최소화.

- 총점(Total Score): 전체 게임 점수의 평균. 0~100% 범위.

인간 기준선은 해당 게임을 처음 접하는 복수의 실험 참가자를 대상으로 설정하며, 2번째로 적은 행동 수를 기록한 인간의 성적을 기준으로 삼는다.

Official vs Community 리더보드

ARC-AGI-3는 두 개의 분리된 리더보드를 운영한다. Official 리더보드는 ARC-AGI-3에 특화된 사전 준비 없이 범용 API 시스템으로만 평가하며, Community 리더보드는 자체 보고 결과와 커스텀 하네스(Harness)를 허용한다.

출시 당시 커뮤니티 최고 점수는 Tufa Labs의 12.58%였으며, 이 역시 강화학습 기반 에이전트를 활용한 결과이다.

| 항목 | ARC-AGI-1 | ARC-AGI-2 | ARC-AGI-3 |

|---|---|---|---|

| 형식 | 정적 격자 | 정적 격자 (고난이도) | 인터랙티브 환경 |

| 인간 점수 | ~100% | ~100% | 100% |

| 프런티어 AI 최고점 | ~93%+ (포화) | ~54% (정제 포함) | 0.51% |

| 채점 방식 | 정답 격자 일치율 | 정답 격자 일치율 | RHAE (행동 효율성 대비) |

| 출시 | 2019 | 2025년 초 | 2026년 3월 25일 |

거대언어모델(LLM) 및 에이전트 역량의 다각도 평가

거대언어모델의 성능 평가는 과거 MMLU(Massive Multitask Language Understanding)와 같이 일반적인 지식 수준을 측정하는 방식에서, 점차 복잡한 추론과 실제 도구 활용 능력을 검증하는 방향으로 이동하고 있습니다.

이는 LLM이 단순한 정보 제공자를 넘어 독립적으로 과업을 수행하는 에이전트로 진화하고 있음을 반영합니다.

SWE-bench Verified: 소프트웨어 엔지니어링의 실전적 검증

SWE-bench는 모델이 실제 소프트웨어 개발 환경에서 발생하는 이슈를 이해하고 직접 코드를 수정하여 해결할 수 있는지를 측정하는 벤치마크입니다.

초기 버전에서 발생했던 문제 모호성과 평가의 불확실성을 해결하기 위해 등장한 SWE-bench Verified는 OpenAI와의 협력을 통해 인간 어노테이터가 엄격하게 필터링한 500개의 인스턴스로 구성됩니다.[1, 2]

SWE-bench Verified의 핵심은 모델이 생성한 패치가 단순히 문법적으로 옳거나 정답과 유사한지를 보는 것이 아니라, **실제 실행 환경에서 테스트를 통과하는지를 확인하는 ‘실행 기반 평가’**에 있습니다.

모델은 특정 이슈에 대한 설명과 관련 코드베이스를 제공받으며, 이를 바탕으로 수정안을 담은 디프(diff) 파일을 생성해야 합니다.[2]

이 diff 파일은 도커(Docker) 컨테이너 내의 실제 코드베이스에 적용되며, 해당 이슈를 해결하기 위해 설계된 테스트 케이스들이 정상적으로 통과되는지, 그리고 기존의 다른 기능들을 망가뜨리지 않는지를 엄격하게 검증합니다.[1, 2]

이 지표의 계산 방법은 전체 태스크 수 대비 성공적으로 패치를 완료한 태스크의 비율로 정의됩니다.

단순히 코드 조각을 작성하는 능력을 넘어, 수만 줄의 대규모 코드베이스에서 버그의 위치를 식별하고 전체 시스템과의 호환성을 유지하며 논리적인 해결책을 도출해야 하므로 난이도가 매우 높습니다.[2]

그러나 비판적인 시각에서는 이러한 데이터가 이미 학습 데이터에 포함되어 있을 가능성(Data Contamination)이 제기되며, 실제로 대다수의 태스크가 1~2줄의 수정으로 해결 가능한 간단한 버그라는 지적도 존재합니다.[2]

따라서 SWE-bench Verified 점수를 해석할 때는 모델이 대규모 시스템 설계 능력을 갖춘 것인지, 아니면 학습 데이터 내의 유사한 해결 패턴을 복제한 것인지를 신중히 구분해야 합니다.

GPQA Diamond: 박사급 과학 추론과 Google-Proof의 의미

GPQA(Graduate-Level Google-Proof Question Answering) Diamond는 생물학, 화학, 물리학 등 전문 과학 분야에서 박사 과정 수준의 지식과 다단계 추론 능력을 요구하는 벤치마크입니다.

‘Diamond’라는 명칭은 전체 GPQA 문제 중에서도 전문가 검증을 통과하고 비전문가가 인터넷 검색을 동원해도 해결하기 어려운 가장 난이도 높은 198개의 문제를 의미합니다.[3, 4]

이 벤치마크의 가장 큰 특징은 ‘Google-proof’ 속성입니다.

단순한 지식 검색으로는 정답을 찾을 수 없도록 설계되었으며, 해당 분야의 박사급 전문가조차 약 65%에서 74% 사이의 정확도를 기록할 정도로 극악의 난이도를 자랑합니다.[3, 5]

반면, 인터넷 검색이 허용된 숙련된 비전문가들의 정확도는 34% 수준에 머무는데, 이는 모델이 단순한 정보 암기가 아닌 깊은 수준의 과학적 원리 이해와 논리적 연쇄를 갖추었는지를 판별하는 기준이 됩니다.[4, 6]

| 지표 항목 | GPQA Diamond 세부 정보 |

|---|---|

| 문제 구성 | 198개 다중 선택형 (4지 선다) [4, 5] |

| 대상 도메인 | 물리, 화학, 생물학 등 하드 사이언스 [5, 6] |

| 전문가 정확도 | 약 69.7% (PhD 소지자 기준) [5, 6] |

| 비전문가 정확도 | 약 34% (30분 이상의 웹 검색 허용 시) [3, 4] |

| 무작위 베이스라인 | 25% [5] |

GPQA Diamond 점수는 모델이 정답을 맞춘 비율로 계산됩니다.

최근 Gemini 3.1 Pro나 o1-series와 같은 모델들은 90% 이상의 점수를 기록하며 인간 전문가를 능가하는 수치를 보여주고 있습니다.[5, 6, 7]

이러한 비약적인 성장은 사고의 사슬(Chain-of-Thought) 기법을 통한 내부적 추론 과정의 고도화에 기인합니다.[5]

하지만 해석 시 주의할 점은, 이러한 높은 점수가 모델이 실제 실험실 데이터를 분석하거나 새로운 가설을 설정하는 능력과 정비례하는 것은 아니라는 점입니다.

GPQA는 여전히 텍스트 기반의 사지선다형 문제라는 형식을 취하고 있으며, 모델이 정답 도출 과정에서 논리적 비약이 있더라도 우연히 정답을 맞출 가능성이나 데이터셋 특유의 패턴을 파악했을 가능성을 배제할 수 없습니다.[7]

Terminal-Bench 2.0: 시스템 관리 역량으로서의 터미널 조작

Terminal-Bench 2.0은 AI 모델이 텍스트 생성을 넘어 실제 컴퓨터 환경에서 명령줄 인터페이스(CLI)를 얼마나 능숙하게 다루는지를 측정합니다.

모델은 가상의 리눅스 터미널 환경에 접속하여 고장 난 프로그램을 수정하거나, 복잡한 파일 시스템 구조를 분석하고 특정 자동화 과업을 수행해야 합니다.[8]

이 지표는 모델의 ‘자동화 가능성’을 측정하는 핵심 도구입니다.

단순히 코드를 짜는 것과, 짠 코드를 실행하고 발생하는 에러 메시지를 분석하여 터미널에서 즉각적으로 대처하는 것은 차원이 다른 문제이기 때문입니다.[8]

Terminal-Bench 2.0 점수는 주어진 관리 과업을 최종적으로 완수했는지를 기준으로 산출되며, 이는 AI 에이전트가 인간 시스템 관리자를 어느 정도 대체하거나 보조할 수 있는지를 보여주는 객관적인 지표로 활용됩니다.[8]

MCP-Atlas: 도구 활용의 오케스트레이션과 워크플로우 숙련도

MCP-Atlas(Model Context Protocol Atlas)는 모델이 다양한 외부 도구(Tools)와 서버를 얼마나 효과적으로 탐색하고 결합하여 복잡한 다단계 워크플로우를 완수하는지를 평가하는 벤치마크입니다.

이는 Anthropic이 주도하는 Model Context Protocol(MCP) 환경을 기반으로 하며, 실제 운영되는 36개의 MCP 서버와 220개 이상의 도구를 활용합니다.[9, 10]

MCP-Atlas의 평가 방법론은 단순히 최종 결과의 일치 여부만을 따지는 기존 방식보다 훨씬 정교합니다.

- Claims-Based Scoring: 모델의 최종 답변이 담고 있어야 할 사실적 주장(Claims)들을 정의하고, 이를 기준으로 부분 점수를 부여한다.[9, 11]

- 커버리지(Coverage): 각 태스크에서 요구하는 세부 주장들이 충족된 비율의 평균으로 계산된다.[11]

- Pass Rate: 특정 태스크에서 커버리지 점수가 75% 이상일 경우에만 해당 태스크를 ‘통과’한 것으로 간주하며, 전체 태스크 대비 통과 비율이 리더보드의 최종 점수가 된다.[11]

이 벤치마크는 모델이 도구의 이름을 직접 언급하지 않는 자연어 프롬프트에서 필요한 도구를 스스로 찾아내고(Discovery), 올바른 파라미터를 입력하며(Parameterization), 에러 발생 시 이를 복구하는 일련의 과정을 진단합니다.[9, 12]

이는 실무 환경에서 AI 에이전트가 “우리 회사의 지난 3년간의 마케팅 데이터를 분석해서 보고서를 작성해줘”와 같은 모호한 요청을 받았을 때, 데이터베이스 접속 도구, 통계 처리 도구, 차트 생성 도구를 순차적으로 호출하여 결과를 도출할 수 있는지를 검증하는 지표입니다.[8, 9]

SimpleQA: 단답형 사실 관계의 정확성과 캘리브레이션

OpenAI에서 발표한 SimpleQA는 모델의 환각(Hallucination) 현상을 측정하기 위해 설계된 벤치마크입니다.

모델이 긴 답변을 늘어놓으며 오류를 숨기는 것을 방지하기 위해, 단 하나의 명확하고 불변하는 답변이 존재하는 짧은 질문들로 구성됩니다.[13, 14]

SimpleQA 점수는 모델이 정답을 맞춘 비율(Correctness)뿐만 아니라, 모델의 ‘캘리브레이션’ 능력을 중요하게 평가합니다.

즉, 모델이 정답을 모를 때 “모른다”고 정직하게 답변하는지(Not Attempted), 아니면 틀린 정보를 자신 있게 내뱉는지(Incorrect)를 구분하여 측정합니다.[14, 15]

이는 엔터프라이즈 환경에서 AI가 잘못된 정보를 사실처럼 전달하여 발생할 수 있는 리스크를 관리하는 데 매우 중요한 객관적 지표입니다.[15]

MMLU 및 MMLU-Pro: 다학문 지식 이해의 범용 척도

MMLU(Massive Multitask Language Understanding)는 Dan Hendrycks 등이 2021년에 발표한 벤치마크로, STEM, 인문학, 사회과학, 전문직 시험 등 57개 학문 분야에 걸쳐 15,000개 이상의 4지 선다형 문제로 구성됩니다.

LLM의 사전 학습이 얼마나 광범위한 지식을 습득했는지를 평가하는 데 가장 널리 사용되는 벤치마크였으나, 현재는 최상위 프런티어 모델들이 88~93% 수준에 도달하며 포화(Saturation) 상태에 진입했습니다.

점수 산출 방식은 정답 선지를 정확히 맞춘 비율(정확도, Accuracy)로 계산하며, 통상 5-shot 방식으로 평가합니다.

즉, 모델에게 5개의 예시 문제와 답을 미리 제공한 뒤, 실제 문제를 풀게 하는 방식이다. GPT-3가 최초 등장 시 약 43%를 기록했던 것에 비해, 현재 최상위 모델들은 인간 전문가 앙상블 수준(약 90%)에 근접하거나 초과하고 있습니다.

포화 문제를 해결하기 위해 등장한 MMLU-Pro는 4지 선다에서 10지 선다로 선택지를 늘리고, 단순 암기보다 복잡한 추론을 요구하는 문제 비중을 대폭 높였습니다.

최상위 모델들도 MMLU-Pro에서는 60~75% 수준에 머물러 여전히 변별력을 유지하고 있습니다.

HumanEval: 코드 생성 능력의 실행 기반 평가

HumanEval은 OpenAI가 2021년에 발표한 코드 생성 벤치마크로, 164개의 수작업으로 작성된 파이썬 프로그래밍 문제로 구성됩니다.

함수 시그니처와 독스트링이 주어지면 모델이 함수 본문을 완성하고, 이를 자동화된 유닛 테스트(Unit Test)를 통해 실제 실행하여 정확성을 검증합니다.

HumanEval의 핵심 평가 지표는 pass@k로, 하나의 문제에 대해 k개의 코드 샘플을 생성했을 때 그 중 최소 하나가 모든 테스트를 통과할 확률을 의미한다.

pass@k = 1 − C(n−c, k) / C(n, k)

여기서 n은 생성된 총 샘플 수, c는 테스트를 통과한 샘플 수입니다.

실용적으로는 pass@1(단 한 번의 시도로 정답을 맞출 확률)이 가장 많이 보고됩니다.

2025년 기준 최상위 모델들은 pass@1 기준 90% 이상을 기록하며 사실상 포화 상태에 근접했습니다.

이를 보완하기 위해 테스트 케이스를 대폭 확장한 **HumanEval+**가 등장했으며, 기본 HumanEval에서 높은 점수를 받은 모델도 HumanEval+에서는 상당히 낮은 점수를 기록하는 경우가 많아, 코드 품질의 엣지 케이스 처리 능력을 보다 정밀하게 검증할 수 있습니다.

GSM8K 및 MATH-500: 수학적 추론 능력의 두 계층

수학 추론 능력은 난이도에 따라 계층적으로 평가됩니다.

GSM8K(Grade School Math 8K)는 초등학교 수준의 수학 문장형 문제 8,500개로 구성된 데이터셋입니다.

각 문제는 2~8단계의 초등 연산(+, −, ×, ÷)을 통해 풀 수 있으며, 모델이 최종 답을 정확히 산출하는지를 측정합니다.

평가는 최종 수치 답이 정답과 일치하는지 여부로 이루어지며, 연쇄 사고(Chain-of-Thought) 프롬프팅 기법의 효과를 검증하는 대표 벤치마크로 사용되어 왔습니다.

그러나 최상위 모델들이 현재 95% 이상을 기록하며 사실상 포화되어, 현재는 소규모 모델 또는 파인튜닝 모델 비교를 위한 기준선 역할에 그치고 있습니다.

MATH-500은 AMC, AIME 등 미국 수학 올림피아드 수준의 경쟁 수학 문제 12,500개로 구성된 MATH 데이터셋에서 엄선된 500개의 대표 문제입니다.

대수, 미적분, 기하, 정수론, 통계 등 5단계 난이도로 분류되며, 중고등학교 수준을 훨씬 초과하는 다단계 기호 추론을 요구합니다.

점수는 최종 답의 정확도로 측정하되, 답을 특정 형식으로 정규화하여 비교합니다.

추론 특화 모델(o1, DeepSeek-R1 등)의 등장으로 최상위 모델들이 90% 이상을 기록하면서 변별력이 낮아지고 있습니다.

AIME: 경쟁 수학의 최전선

AIME(American Invitational Mathematics Examination)는 미국 최고 권위의 수학 경시대회 문제를 기반으로 하는 벤치마크입니다.

0에서 999 사이의 정수를 직접 서술하는 방식으로 답해야 하며, 사지선다 방식의 MATH-500보다 훨씬 높은 난이도를 자랑합니다.

AIME 2024, AIME 2025 등 연도별로 매년 갱신되어 데이터 오염(Contamination) 문제를 완화한다는 장점이 있습니다.

점수는 30개 문제 중 정답을 맞춘 개수 또는 pass@1 정확도로 표현됩니다.

일반 LLM은 10% 미만의 정확도를 보이는 반면, 추론 특화 모델(o1, Gemini 2.0 Flash Thinking 등)은 70~90% 이상을 기록하여 수학 추론 능력의 최전선 지표로 활용됩니다.

Chatbot Arena (Arena Elo): 인간 선호도 기반의 실전적 순위

Chatbot Arena(구 LMSYS Arena)는 UC Berkeley와 LMSYS가 운영하는 크라우드소싱 기반의 LLM 평가 플랫폼입니다.

자동화된 지표의 한계를 극복하기 위해 실제 인간의 선호도 판단을 직접 수집하는 방식을 채택하고 있습니다.

평가 방식은 이중 맹검(Double-Blind) 형식입니다.

사용자가 질문을 입력하면, 어떤 모델인지 공개되지 않은 두 모델의 응답이 나란히 제시됩니다.

사용자는 두 응답 중 더 좋다고 판단되는 쪽을 투표하거나 무승부로 처리합니다.

투표 결과는 체스의 Elo 점수 시스템을 기반으로 한 Bradley-Terry 모델을 통해 집계됩니다.

각 모델의 현재 Elo 점수 차이를 기반으로 승리 확률을 예측하고, 실제 대결 결과에 따라 점수를 업데이트하는 방식입니다.

6백만 건 이상의 인간 투표 데이터를 보유하고 있으며, 코딩, 수학, 창작 등 카테고리별로 세분화된 Elo 점수도 제공합니다.

자동화 벤치마크보다 게임화(Gaming)에 강인하다는 장점이 있으나, 투표자 집단의 편향, 특정 응답 스타일 선호 등의 한계도 존재합니다.

| 항목 | Arena Elo 세부 정보 |

|---|---|

| 투표 방식 | 이중 맹검(Double-Blind) 익명 A/B 비교 투표 |

| 점수 산출 | Bradley-Terry 모델 기반 Elo 레이팅 (체스의 Elo 시스템 응용) |

| 데이터 규모 | 누적 600만+ 건의 인간 투표 |

| 강점 | 실제 인간 선호도 반영, 게임화(Contamination) 저항성 높음 |

| 한계 | 투표자 모집단 편향, 특정 글쓰기 스타일 선호 반영 가능 |

IFEval: 명시적 지시 준수 능력의 정밀 측정

IFEval(Instruction Following Evaluation)은 모델이 사용자의 명시적 형식 지시를 얼마나 충실히 따르는지를 측정하는 벤치마크입니다.

“응답을 500단어 이내로 작성하라”, “JSON 형식으로 출력하라”, “응답에 특정 키워드를 포함하라” 등 객관적으로 검증 가능한 542개의 지시-응답 쌍으로 구성된다.

평가 지표는 네 가지로 세분화된다.

- Prompt-level Strict Accuracy: 프롬프트 내 모든 지시를 완벽히 따른 경우만 정답으로 인정.

- Prompt-level Loose Accuracy: 지시 준수 여부를 약간 유연하게 판단.

- Instruction-level Strict Accuracy: 개별 지시 하나하나를 엄격히 검증.

- Instruction-level Loose Accuracy: 개별 지시를 유연하게 검증.

주관적 판단 없이 규칙 기반으로 자동 채점이 가능하다는 장점 때문에, 실무 환경에서 AI가 정해진 형식과 제약을 준수하는지를 검증하는 핵심 지표로 활용됩니다.

특히 에이전트나 API 통합 환경에서 지시 준수 능력은 비즈니스 신뢰성의 핵심 요소입니다.

Needle in a Haystack (NIAH): 장문 컨텍스트 검색 능력

Needle in a Haystack(바늘 찾기) 테스트는 LLM의 장문 컨텍스트 처리 및 정보 검색 능력을 평가하는 방법이다. Greg Kamradt가 처음 개발하여 2023년 GPT-4와 Claude 2.1의 비교 분석에 활용된 것으로 유명해졌다.

평가 방식은 다음과 같다. 긴 텍스트(예: Paul Graham의 에세이)를 ‘건초더미(Haystack)’로 삼고, 그 안에 정답이 될 특정 사실(‘바늘(Needle)’)을 삽입한다.

그 후 모델에게 바늘에 해당하는 정보를 질문하여 올바르게 검색해내는지를 측정한다. 이를 두 가지 축으로 반복 측정한다.

- 컨텍스트 길이(Context Length): 1K 토큰부터 모델의 최대 컨텍스트 윈도우까지 단계별로 늘려가며 측정.

- 문서 내 삽입 깊이(Document Depth %): 바늘을 문서의 맨 앞(0%)부터 맨 뒤(100%)까지 다양한 위치에 배치하여 측정.

최종 결과는 컨텍스트 길이 × 삽입 깊이의 2D 히트맵으로 시각화되며, 점수는 바늘을 올바르게 검색한 비율(정확도)로 산출된다. 이 테스트는 모델이 주장하는 컨텍스트 윈도우 크기와 실제 정보 검색 성능 간의 격차를 드러내는 데 특히 효과적이다. 단순 NIAH가 포화 상태에 이르자, 여러 개의 바늘을 삽입하거나 추론이 필요한 변형 테스트(RULER, NoLiMa 등)가 등장했다.

Humanity’s Last Exam (HLE): 포화된 벤치마크의 한계를 초월

Humanity’s Last Exam은 MMLU와 GPQA Diamond 등 기존 벤치마크들이 최상위 모델들에 의해 포화되자, AI Safety를 연구하는 Dan Hendrycks(Center for AI Safety)와 Scale AI가 2024년 공동으로 개발한 초난이도 벤치마크입니다.

100개 이상의 학문 분야에서 전 세계 전문가들이 출제한 2,500개의 문제로 구성되며, 문제 선별 과정에서 GPT-4나 고성능 모델이 이미 맞출 수 있는 문제는 제외하는 역선택 방식을 채택했습니다.

수학, 자연과학, 공학, 인문학 등 다양한 분야의 최전선 지식을 요구하며, 웹 검색이나 패턴 암기로는 풀 수 없도록 설계되었습니다.

점수는 정답 정확도로 측정되며, 도구 사용이 허용된 환경에서도 최상위 모델이 50% 내외의 정확도를 기록하는 수준입니다.

도구 미사용 시에는 20~30% 수준에 머물러, 현존하는 LLM과 인간 전문가 간의 실질적인 능력 격차를 보여주는 현재 가장 변별력 있는 프런티어 벤치마크입니다

| 지표명 | 카테고리 | 측정 방식 | 포화 여부 |

|---|---|---|---|

| MMLU | 일반 지식 | 4지선다 정확도 (5-shot) | 포화 (~90%) |

| MMLU-Pro | 일반 지식 (고난이도) | 10지선다 정확도 | 미포화 (60~75%) |

| HumanEval | 코딩 | pass@k (유닛 테스트 통과율) | 거의 포화 (90%+) |

| GSM8K | 초등 수학 | 최종 답 일치율 | 포화 (95%+) |

| MATH-500 | 경쟁 수학 | 정규화된 최종 답 정확도 | 상위권 포화 추세 |

| AIME | 최상위 수학 | pass@1 정확도 (0~999 정수 직접 서술) | 미포화 (추론 모델 기준 분화) |

| Chatbot Arena Elo | 전반적 선호도 | Bradley-Terry 기반 Elo 레이팅 | 지속 갱신 |

| MT-Bench | 다중 대화 품질 | LLM-as-a-Judge (GPT-4 채점, 1~10점) | 거의 포화 (9.0+) |

| IFEval | 지시 준수 | 규칙 기반 자동 채점 (Prompt/Instruction 레벨) | 미포화 |

| TruthfulQA | 진실성/환각 | GPT-Judge 분류 모델 (진실성 + 정보성) | 미포화 |

| NIAH | 장문 컨텍스트 | 정확도 (컨텍스트 길이 × 삽입 깊이 2D 히트맵) | 단순 NIAH는 포화 |

| HLE | 초난이도 종합 | 정답 정확도 (도구 사용/미사용 구분) | 미포화 (현재 최전선 지표) |

LiveCodeBench: 오염 방지형 실시간 코딩 평가

LiveCodeBench는 HumanEval이 데이터 오염 및 포화 문제에 따라, LeetCode, AtCoder, Codeforces 등 실제 경진대회 플랫폼에서 새 문제를 지속적으로 수집하여 제공하는 코딩 벤치마크입니다.

매월 새로운 문제를 추가함으로써 모델의 학습 데이터 cut-off 이후에 출제된 문제를 평가에 활용하여 데이터 오염을 구조적으로 차단합니다.

평가 범위는 단순 코드 생성을 넘어 4가지 시나리오를 포괄한다.

- 코드 생성(Code Generation): 문제 설명을 읽고 완전한 코드를 작성하는 능력.

- 자체 수정(Self-Repair): 오류가 있는 코드를 스스로 파악하고 수정하는 능력.

- 코드 실행(Code Execution): 주어진 입력값에 대한 코드 실행 결과 예측.

- 테스트 출력 예측(Test Output Prediction): 코드를 설명만 보고 테스트 결과를 예측하는 능력.

점수는 pass@1 정확도로 측정되며, 2026년 4월 기준 Gemini 3 Pro Preview가 91.7%로 1위, Kimi 2.6이 89.6%로 근소한 차이를 보이고 있습니다.

HumanEval에 비해 더 높은 도연성과 실제 문제 해결 능력을 측정하여, 코딩 에이전트의 실무 능력을 더 정확하게 판정할 수 있는 지표로 자리잡고 있다.

광학 문자 인식(OCR) 및 문서 이해의 정량적 평가 체계

OCR 기술의 핵심은 이미지 속에 배열된 시각적 기호들을 인간이 의도한 디지털 텍스트로 얼마나 오차 없이 변환하느냐에 있습니다.

이를 측정하기 위해 가장 고전적이면서도 강력한 지표는 편집 거리(Edit Distance)에 기반한 비율들입니다.

Character Error Rate (CER) 및 Word Error Rate (WER)

CER과 WER은 OCR뿐만 아니라 음성 인식(ASR) 분야에서도 통용되는 가장 보편적인 성능 지표입니다.

두 지표 모두 레벤슈타인 알고리즘을 통해 계산된 편집 연산의 횟수를 기준 텍스트의 총 길이로 나누어 산출합니다.[16, 17]

CER=NS+D+I×100

이 수식에서 각 변수의 의미는 다음과 같습니다.

- S (Substitutions): ‘A’를 ‘4’로 인식하는 등 오인식된 문자의 수.

- D (Deletions): 텍스트가 존재함에도 불구하고 인식하지 못하고 누락시킨 문자의 수.

- I (Insertions): 배경 노이즈를 문자로 오인하는 등 정답지에 없는 문자를 생성해낸 수.

- N: 기준 텍스트(Ground Truth)의 총 문자 수.[16, 17, 18]

CER 점수가 0%에 가까울수록 완벽한 인식 능력을 의미하지만, 삽입 오류(I)가 과도하게 발생할 경우 이 점수는 100%를 초과할 수 있다는 점을 유의해야 합니다.[17, 18]

실제 산업 현장에서는 인쇄된 문서의 경우 1% 미만의 CER을 우수한 수준으로 보며, 필기체나 훼손된 문서의 경우 5~15% 내외를 수용 가능한 범위로 설정합니다.[17]

| 인식 대상 | 우수 기준 (CER) | 수용 가능 임계치 (CER) |

|---|---|---|

| 인쇄된 문서 | 0% ~ 1% | 5% 미만 [17] |

| 깨끗한 수기 원고 | 2% ~ 5% | 15% 미만 [17] |

| 역사적 고문서 | 8% ~ 15% | 30% 미만 [17] |

Normalized Edit Distance (NED) 및 TEDS

NED는 편집 거리를 단순히 합산하는 것이 아니라, 결과물과 정답지 사이의 유사도를 0에서 1 사이의 값으로 정규화한 지표입니다.

이는 텍스트의 길이에 따른 왜곡을 줄여주어 서로 다른 길이의 문서를 비교할 때 효과적입니다.[19, 20]

NED=1−max(∣H∣,∣R∣)dedit(H,R)

또한 표(Table) 구조 인식 능력을 평가하기 위해 사용되는 TEDS(Tree Edit Distance based Similarity)는 단순한 텍스트 나열이 아닌, 행(Row)과 열(Column)의 논리적 구조를 트리 형태로 변환하여 그 구조적 일치도를 측정합니다.[19]

이는 복잡한 재무제표나 도표가 포함된 문서를 자동화 처리할 때 실제적인 성능을 가늠하는 척도가 됩니다.

이미지 생성 모델의 품질 및 정렬 지표

이미지 생성 모델은 단순히 시각적으로 아름다운 이미지를 만드는 것을 넘어, 사용자의 프롬프트 의도를 얼마나 정확히 반영했는지(Alignment)와 생성된 이미지의 통계적 분포가 실제 세계와 얼마나 유사한지(Fidelity)를 평가받아야 합니다.

Inception Score (IS)와 Fréchet Inception Distance (FID)

초기 생성 AI 평가의 표준이었던 IS는 생성된 이미지가 명확한 객체를 포함하고 있는지(Fidelity)와 다양한 클래스를 생성하는지(Diversity)를 측정했습니다.[21]

하지만 IS는 실제 데이터와의 비교 없이 생성된 결과물만 보고 판단한다는 치명적인 약점이 있었습니다.

이를 극복하기 위해 등장한 지표가 FID이다.[21, 22]

FID는 실제 이미지 데이터셋(Ground Truth)과 생성된 이미지 데이터셋 간의 특징 분포 거리를 측정합니다.

이를 위해 사전 학습된 Inception-v3 모델의 마지막 풀링 레이어를 사용하여 각 이미지 셋의 특징 벡터를 추출하고, 이 벡터들의 평균과 공분산을 비교합니다.[21, 22]

FID 점수가 낮을수록 생성된 이미지가 실제 데이터와 통계적으로 유사함을 의미하며, 이는 육안으로 보기에 더 사실적인 결과물임을 뜻합니다.[21, 22]

그러나 FID는 특징 벡터가 가우시안 분포를 따른다는 가정을 전제로 하며, 샘플의 크기가 작을 때 점수가 편향되는 특성이 있어 최소 수만 개의 샘플을 기반으로 측정해야 신뢰도를 얻을 수 있습니다.[21]

CLIP Score 및 HPS v2: 인간의 눈으로 보는 AI

통계적 분포뿐만 아니라 사용자의 지시를 얼마나 잘 따랐는지를 측정하는 지표로 CLIP Score가 활용됩니다.

이는 이미지와 텍스트를 동일한 벡터 공간에 매핑하는 CLIP 모델을 사용하여, 입력된 프롬프트와 생성된 이미지 사이의 코사인 유사도를 계산한다.[23]

나아가 HPS v2(Human Preference Score)는 수십만 건의 인간 선호도 데이터를 학습한 모델을 통해, 특정 이미지가 인간에게 얼마나 더 선호될지를 예측합니다.[24, 25]

이는 단순히 선명한 이미지를 만드는 것을 넘어, 예술적인 구도나 색감 등 정성적인 측면에서 AI 모델의 우수성을 객관화하는 도구로 쓰인다.[25]

| 지표명 | 측정 목적 | 주요 특징 |

|---|---|---|

| FID | 이미지의 실재성 및 다양성 | 낮을수록 실제 이미지 분포와 유사함 [21, 22] |

| CLIP Score | 프롬프트 준수 여부 | 높을수록 텍스트 설명과 이미지가 일치함 [23] |

| HPS v2 | 인간 선호도 예측 | 인간이 더 아름답거나 정확하다고 느낄 확률 측정 [25] |

| CMMD | FID의 현대적 대안 | 가우시안 가정 없이 CLIP 임베딩을 통한 정확한 거리 측정 [21] |

음성 및 오디오 모델의 다차원 평가 지표

음성 인식 및 생성 모델의 평가는 명료도라는 기술적 측면과 자연스러움이라는 감성적 측면을 동시에 고려해야 한다.

Mean Opinion Score (MOS) 및 객관적 오디오 지표

MOS는 인간 평가자가 오디오 샘플을 직접 듣고 1점(아주 나쁨)에서 5점(아주 좋음)까지 점수를 매기는 가장 전통적이고 신뢰할 수 있는 방식입니다.[26, 27]

통상적으로 4.3 이상의 점수는 인간의 육성과 구분이 어려운 수준으로 평가 받습니다.[18]

하지만 인간 평가의 높은 비용을 해결하기 위해 객관적 지표들이 병행됩니다.

- Mel-Cepstral Distortion (MCD): 합성음과 원음의 스펙트럼 포락선 차이를 측정하여 음색의 일치도를 평가한다. 값이 낮을수록 기계적인 느낌이 줄어들고 자연스럽습니다.[26, 27]

- Fréchet Audio Distance (FAD): 이미지의 FID와 동일한 원리로, 오디오 임베딩 분포 간의 거리를 측정한다. 정답지가 없는 환경에서도 전체적인 생성 품질을 평가할 수 있는 강력한 Reference-free 지표입니다.[28, 29]

- F0 Correlation: 생성된 음성의 피치(Pitch) 변화가 얼마나 자연스러운지를 측정하여, 감정 표현이나 억양의 적절성을 가늠합니다.[27]

음성 에이전트의 비즈니스 지표: TSR 및 FCR

음성 모델이 단순히 소리를 만드는 단계를 넘어 ‘음성 에이전트’로 활용될 때는 기술적 지표 외에도 비즈니스 성과 지표가 중요합니다.

- TSR (Task Success Rate): AI 상담원이 고객의 요청을 최종적으로 완수했는지의 비율.[18]

- FCR (First Call Resolution): 첫 번째 통화에서 문제가 해결된 비율로, 에이전트의 효율성을 나타낸다.[18]

- Latency (지연 시간): 인간의 대화 기대치인 300ms를 충족하는지 여부는 사용자 경험의 핵심이다.[18]

참고자료

- SWE-bench Verified, https://www.swebench.com/verified.html

- What those AI benchmark numbers mean | ngrok blog, https://ngrok.com/blog/ai-benchmarks

- GPQA Diamond Benchmark Leaderboard – Artificial Analysis, https://artificialanalysis.ai/evaluations/gpqa-diamond

- GPQA Diamond benchmark | General reasoning agent evaluation | Steel.dev, https://leaderboard.steel.dev/registry/benchmarks/gpqa-diamond/

- GPQA-Diamond Benchmark: Scores, Leaderboard & How AI Models Compare, https://intuitionlabs.ai/articles/gpqa-diamond-ai-benchmark

- GPQA Diamond Benchmark – AI Science Performance Leaderboard | Omic | Omic Glossary, https://omic.ai/glossary/gpqa-diamond

- GPQA – Vals AI, https://www.vals.ai/benchmarks/gpqa

- Everyone Talks About AI Benchmarks But What Are They? | by …, https://medium.com/@ragularumugam/everyone-talks-about-ai-benchmarks-but-what-are-they-b4b801ec2f95

- MCP-Atlas: A Large-Scale Benchmark for Tool-Use Competency with Real MCP Servers, https://arxiv.org/html/2602.00933v1

- [2602.00933] MCP-Atlas: A Large-Scale Benchmark for Tool-Use Competency with Real MCP Servers – arXiv, https://arxiv.org/abs/2602.00933

- MCP Atlas – Scale Labs Leaderboard, https://labs.scale.com/leaderboard/mcp_atlas

- scaleapi/mcp-atlas – GitHub, https://github.com/scaleapi/mcp-atlas

- Introducing SimpleQA | OpenAI, https://openai.com/index/introducing-simpleqa/

- SimpleQA Leaderboard | Kaggle, https://www.kaggle.com/benchmarks/openai/simpleqa

- OpenAI’s New QA Benchmark: SimpleQA | by AI In Transit – Medium, https://aiintransit.medium.com/openais-new-qa-benchmark-simpleqa-ed70ee304517

- Understanding Character Error Rate (CER) for AI Accuracy | Galileo, https://galileo.ai/blog/character-error-rate-cer-metric

- Understanding Character Error Rate Formula and Calculation, https://www.llamaindex.ai/glossary/what-is-character-error-rate

- Voice Agent Evaluation Metrics: Definitions, Formulas … – Hamming AI, https://hamming.ai/resources/voice-agent-evaluation-metrics-guide

- OCRTurk: A Comprehensive OCR Benchmark for Turkish – arXiv, https://arxiv.org/html/2602.03693v1

- A Normalized Levenshtein Distance Metric ا – OpenReview, https://openreview.net/pdf?id=kXYl48LfTu

- Evaluation metrics for generative image models – SoftwareMill, https://softwaremill.com/evaluation-metrics-for-generative-image-models/

- Fréchet inception distance – Wikipedia, https://en.wikipedia.org/wiki/Fréchet_inception_distance

- Evaluating Diffusion Models – Hugging Face, https://huggingface.co/docs/diffusers/conceptual/evaluation

- tgxs002/HPSv2: Human Preference Score v2: A Solid Benchmark for Evaluating Human Preferences of Text-to-Image Synthesis – GitHub, https://github.com/tgxs002/HPSv2

- [2306.09341] Human Preference Score v2: A Solid Benchmark for Evaluating Human Preferences of Text-to-Image Synthesis – arXiv, https://arxiv.org/abs/2306.09341

- What are common metrics for evaluating TTS quality? – Milvus, https://milvus.io/ai-quick-reference/what-are-common-metrics-for-evaluating-tts-quality

- How Good Is That AI Voice? A Simple Guide to Audio Evaluation Metrics (with FreeVC as an Example) | by Hassan Javaid | Medium, https://medium.com/@hassan.javaid263/how-good-is-that-ai-voice-a-simple-guide-to-audio-evaluation-metrics-with-freevc-as-an-example-28fb50772f3d

- Fréchet Audio Distance for Audio Quality – Emergent Mind, https://www.emergentmind.com/topics/frechet-audio-distance

- Frechet Audio Distance: A Reference-Free Metric for Evaluating Music Enhancement Algorithms – ISCA Archive, https://www.isca-archive.org/interspeech_2019/kilgour19_interspeech.pdf

- SimpleQA Verified: A Reliable Factuality Benchmark to Measure Parametric Knowledge, https://arxiv.org/html/2509.07968v2

- Evals – Google DeepMind, https://deepmind.google/research/evals/

- Anthropic vs OpenAI vs Google: Three Different Bets on the Future of …, https://www.mindstudio.ai/blog/anthropic-vs-openai-vs-google-agent-strategy

- Technical Performance | The 2026 AI Index Report | Stanford HAI, https://hai.stanford.edu/ai-index/2026-ai-index-report/technical-performance